5월 15일에 나온 한 논문에서 AI 에이전트와 에이전틱 AI를 다른 개념으로 설명하고 있네요.

이 부분에 대해 실제 현업에 계신 엔지니어 분들의 고견을 들어보고 싶습니다 ![]() !!

!!

요약본 공유드려요, 원문은 영문입니다.

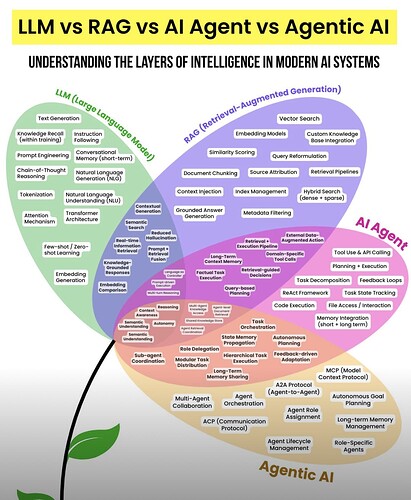

1. AI 에이전트 (AI Agents)

- 정의: 대규모 언어 모델(LLM)이나 대규모 이미지 모델(LIM)을 기반으로 특정 작업을 자동화하는 모듈형 시스템입니다.

- 특징 :

- 자율성: 일정 수준의 자율성을 가지며, 주어진 작업을 독립적으로 수행합니다.

- 작업 특화: 특정한 작업에 최적화되어 있으며, 예를 들어 이메일 필터링, 일정 관리, 문서 요약 등에 활용됩니다.

- 반응성: 환경 변화나 사용자 입력에 반응하여 동작합니다.

- 제한사항: 복잡한 계획 수립이나 인과적 추론 능력이 부족하여, 다단계 작업이나 협업이 필요한 시나리오에서는 한계가 있습니다.

2. Agentic AI

- 정의: 여러 AI 에이전트가 협력하여 복잡한 목표를 달성하는 시스템으로, 자율성과 적응성이 향상된 형태입니다.

- 특징 :

- 다중 에이전트 협업: 여러 에이전트가 역할을 분담하고 협력하여 작업을 수행합니다.

- 동적 작업 분해: 복잡한 목표를 하위 작업으로 분해하고, 이를 각 에이전트에 할당합니다.

- 지속적인 메모리: 작업 수행 중 얻은 정보를 기억하고 활용하여, 지속적인 학습과 적응이 가능합니다.

- 조정된 자율성: 전체 시스템의 목표를 달성하기 위해 에이전트 간의 행동이 조정됩니다.

- 응용 분야: 연구 자동화, 로봇 협업, 의료 의사결정 지원 등 복잡하고 동적인 환경에서 활용됩니다.

| 항목 | AI 에이전트 (AI Agents) | Agentic AI |

|---|---|---|

| 구조 | 단일 에이전트 중심 | 다중 에이전트 협업 |

| 자율성 수준 | 제한된 자율성 | 높은 자율성과 적응성 |

| 작업 범위 | 단일, 특정 작업 | 복잡한 다단계 작업 |

| 학습 및 적응 | 제한적 학습 | 지속적인 학습과 적응 |

| 응용 분야 | 고객 지원, 일정 관리 등 | 연구, 로봇 협업, 의료 지원 등 |

주요 도전 과제

AI 에이전트의 도전 과제

- 인과적 추론 부족: 통계적 연관성은 파악할 수 있으나, 원인과 결과를 이해하는 능력이 부족합니다.

- 계획 수립의 한계: 복잡한 작업을 계획하고 실행하는 데 어려움이 있습니다.

- 오류 발생 가능성: 잘못된 정보 생성(환각)이나 제한된 적응성으로 인해 오류가 발생할 수 있습니다.

Agentic AI의 도전 과제

- 에이전트 간 조정의 복잡성: 여러 에이전트 간의 협업과 조정이 복잡하여, 오류 전파나 비효율이 발생할 수 있습니다.

- 설명 가능성 부족: 시스템의 결정 과정이 복잡하여, 결과에 대한 설명이 어려울 수 있습니다.

- 보안 및 신뢰성 문제: 에이전트 간의 상호작용이 많아질수록, 보안 취약점이나 신뢰성 문제가 증가할 수 있습니다.

제안된 해결책 및 향후 방향

- ReAct 루프: 에이전트가 행동 후 결과를 관찰하고, 이를 기반으로 다음 행동을 결정하는 반복 구조를 통해, 더 나은 의사결정을 지원합니다.

- RAG (Retrieval-Augmented Generation): 외부 지식 기반에서 정보를 검색하여, 더 정확하고 신뢰할 수 있는 응답을 생성합니다.

- 오케스트레이션 계층: 에이전트 간의 조정을 담당하는 계층을 도입하여, 협업의 효율성과 안정성을 향상시킵니다.

- 인과 모델링: 시스템이 원인과 결과를 이해하고 예측할 수 있도록, 인과 관계를 모델링하는 방법을 적용합니다.